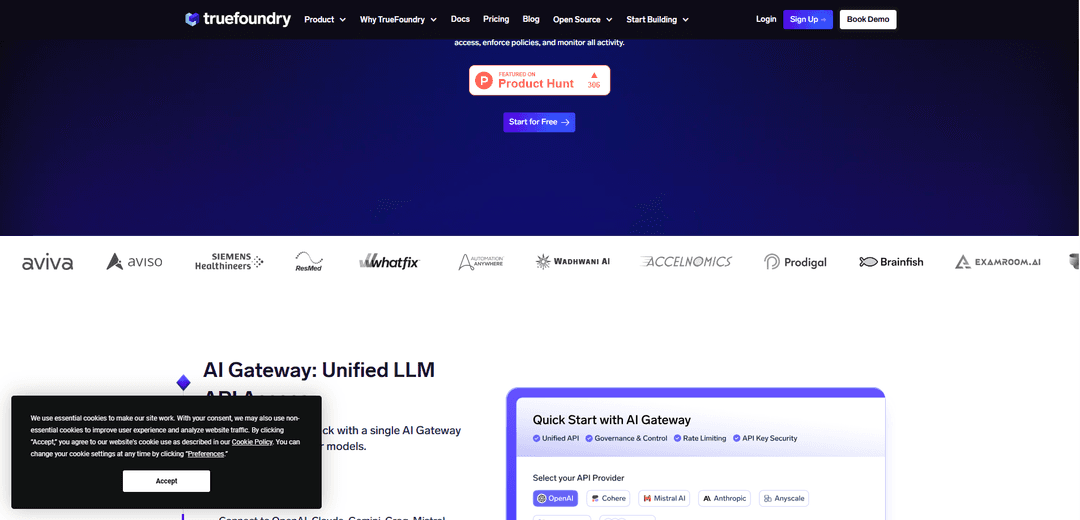

TrueFoundry AI Gateway

TrueFoundry AI Gatewayは、組み込みのセキュリティ、可観測性、およびパフォーマンス最適化機能を備えた統一APIを介して、組織がLLMおよびGen-AIワークロードをデプロイ、管理、および監視できるようにするエンタープライズグレードのコントロールプレーンです。

https://www.truefoundry.com/ai-gateway?ref=producthunt&utm_source=aipure

製品情報

更新日:2025年12月09日

TrueFoundry AI Gatewayとは

TrueFoundry AI Gatewayは、アプリケーションと複数のLLMプロバイダーの間にある一元化されたミドルウェアレイヤーとして機能し、AIモデルの翻訳者およびトラフィックコントローラーとして機能します。OpenAI、Claude、Gemini、Groq、Mistral、および250以上の他のモデルのようなさまざまなLLMプロバイダーを接続、管理、監視するための単一のインターフェースを提供します。このゲートウェイは、認証、ルーティング、レート制限、可観測性、ガバナンスなどの重要なインフラストラクチャのニーズを処理し、組織がセキュリティとコンプライアンスを維持しながらAI運用を標準化できるようにします。

TrueFoundry AI Gatewayの主な機能

TrueFoundry AI Gatewayは、包括的なセキュリティ、可観測性、ガバナンス機能を備え、1000以上のLLMへの統一アクセスを提供するエンタープライズグレードのミドルウェアプラットフォームです。API管理、モデルルーティング、コスト追跡、パフォーマンス監視を一元的に制御し、VPC、オンプレミス、またはエアギャップ環境全体でのデプロイをサポートします。このプラットフォームにより、組織はロードバランシング、フェイルオーバーメカニズム、詳細な分析などの機能を通じて、ガードレールを実装し、コンプライアンスポリシーを適用し、AI運用を最適化できます。

統一されたモデルアクセスと制御: OpenAI、Claude、Gemini、カスタムモデルなど、複数のプロバイダーにわたる一元化されたキー管理、レート制限、およびRBAC制御を備えた、1000以上のLLMにアクセスするための単一のAPIエンドポイント

包括的な可観測性: デバッグと最適化のための詳細なリクエストレベルのロギングおよびトレース機能を備えた、トークン使用量、レイテンシ、コスト、およびパフォーマンスメトリックのリアルタイム監視

高度なセキュリティとコンプライアンス: SOC 2、HIPAA、およびGDPRコンプライアンス要件のサポートを備えた、PII検出、コンテンツモデレーション、およびポリシー適用用の組み込みガードレール

高性能アーキテクチャ: インテリジェントなロードバランシングと自動フェイルオーバーメカニズムを特徴とする、1 vCPUで350+ RPSを処理できる、3ms未満の内部レイテンシ

TrueFoundry AI Gatewayのユースケース

エンタープライズAIガバナンス: 複数のチームやアプリケーションにわたるAIの使用状況の一元的な制御と監視を実装し、コンプライアンスとコスト管理を保証する大規模組織

ヘルスケアAIアプリケーション: HIPAAコンプライアンス、PII保護、および厳格なデータガバナンス要件を備えたAIソリューションをデプロイする医療機関

マルチモデル本番システム: AIインフラストラクチャの統一された管理、監視、および最適化を必要とする、本番環境で複数のAIモデルを実行している企業

セキュアなエージェント開発: 安全なツール統合、プロンプト管理、およびさまざまなエンタープライズシステムへの制御されたアクセスを必要とするAIエージェントを構築する組織

メリット

低レイテンシと優れたスケーラビリティを備えた高性能

包括的なセキュリティおよびコンプライアンス機能

豊富な可観測性と監視機能

柔軟なデプロイオプション(クラウド、オンプレミス、エアギャップ)

デメリット

エンタープライズデプロイメントには、かなりのセットアップと構成が必要になる場合があります

AIのニーズが単純な小規模組織にとっては複雑になる可能性があります

TrueFoundry AI Gatewayの使い方

TrueFoundryアカウントの作成: TrueFoundryアカウントにサインアップし、トークン生成手順に従ってパーソナルアクセストークン(PAT)を生成します。

ゲートウェイ構成の詳細を取得: TrueFoundryプレイグラウンドの統一コードスニペットから、TrueFoundry AI GatewayのエンドポイントURL、ベースURL、およびモデル名を取得します。

APIクライアントの構成: コードでapi_key(PAT)とbase_url(ゲートウェイURL)を構成して、TrueFoundry Gatewayを使用するようにOpenAIクライアントを設定します。

モデルプロバイダーの選択: 統一されたGateway APIを介して、OpenAI、Anthropic、Gemini、Groq、Mistralなどの利用可能なモデルプロバイダーから選択します。

アクセス制御の設定: Gateway管理インターフェースを介して、チームとユーザーのレート制限、予算、およびRBACポリシーを構成します。

ガードレールの実装: Gatewayのガードレール構成を使用して、入力/出力の安全チェック、PII制御、およびコンプライアンスルールを設定します。

監視の有効化: レイテンシー、トークンの使用量、コスト、およびパフォーマンスを追跡するために、メトリック、ログ、およびトレースを構成して、可観測性を設定します。

プレイグラウンドでのテスト: 本番環境に実装する前に、インタラクティブなプレイグラウンドUIを使用して、さまざまなモデル、プロンプト、および構成をテストします。

本番環境へのデプロイ: Gatewayを本番環境の推論パスに配置し、パフォーマンスを監視しながらライブトラフィックをルーティングします。

最適化とスケーリング: Gateway分析を使用して、コストを最適化し、レイテンシーを改善し、使用パターンに基づいてインフラストラクチャをスケーリングします。

TrueFoundry AI Gatewayのよくある質問

TrueFoundry AI Gatewayは、アプリケーションとLLMプロバイダー/MCPサーバーの間に位置するプロキシレイヤーです。単一のAPIを通じて250以上のLLM(OpenAI、Claude、Gemini、Groq、Mistralなど)への統一されたアクセスを提供し、APIキー管理を一元化し、トークン使用量とパフォーマンスメトリクスの可観測性を実現し、ガバナンスポリシーを適用します。チャット、補完、埋め込み、およびリランキングモデルタイプをサポートしながら、3ms未満の内部レイテンシーを保証します。