AIが急速に進歩する中、ユーザー体験を向上させながら安全性を優先するツールの導入が不可欠となっています。Nous Chatは、ChatGPTに似た使い慣れたインターフェースを備え、倫理的な使用と堅固なデータプライバシー対策を重視しています。高度なガードレールを統合することで、ユーザーと効果的にコミュニケーションを取りながら、機密情報を保護しています。

Nous Chatの登場

Nous ResearchによるNous Chatの導入は、AI開発における重要な転換点を示しています。当初は「制限のない」AIモデルとして注目されましたが、このチャットボットは、ユーザーエンゲージメントを維持しながら誤用を防ぐ重要な安全機能を組み込むように進化しました。Hermes 3-70Bモデルは、従来のチャットボットとは一線を画す推論能力と実験的機能を提供するように設計されています。

Nous Chatの主な特徴

- 強化されたガードレール:このチャットボットは、対話中に機密情報が漏洩することを防ぐ高度なプライバシー対策を備えています。これは、ユーザーがデータ保護の保証を求める機会が増えている現在、非常に重要です。

- ユーザー中心の設計:人気のチャットボットを思わせるインターフェースを採用し、技術に精通したユーザーからカジュアルユーザーまで、誰もが使いやすい体験を提供することを目指しています。

- 実験的機能:実験的機能の統合により、ユーザーのフィードバックや対話パターンに基づいて継続的な改善が可能となり、ユーザーのニーズに合わせてチャットボットが進化することを保証します。

他のAIチャットボットとのNous Chat比較

AIチャットボットが増加する中、Nous Chatが競合他社に対してどのような位置づけにあるかを理解することが重要です。以下の表で主な違いを示します:

| 機能 | Nous Chat | 他のAIチャットボット |

| ガードレール | 高度なプライバシー対策 | 実装により様々 |

| ユーザーインターフェース | 使い慣れた直感的なデザイン | 多様なデザイン |

| 実験的機能 | あり | 多くの場合限定的 |

この比較から、多くのチャットボットが存在する中で、Nous Chatほどユーザーのプライバシーを重視しているものは少ないことがわかります。

AI安全性の将来への影響

Nous Chatの立ち上げは、単なる新しいツールの導入ではなく、AIコミュニティ全体における倫理基準とユーザー安全性を優先する広範な取り組みを示しています。より多くの開発者が同様のガードレールをモデルに採用するにつれ、様々なアプリケーションでより責任のあるAI使用へのシフトが期待されます。

さらに、Lighthouz AIがHugging Faceと協力して立ち上げたChatbot Guardrails Arenaのような取り組みは、様々なLLM(大規模言語モデル)を敵対的シナリオに対してストレステストすることを目的としています。このコミュニティ主導のアプローチは、異なるAIプラットフォーム間でプライバシーとセキュリティのベンチマークを確立し、これらの技術への信頼をさらに高めることに役立ちます。

結論

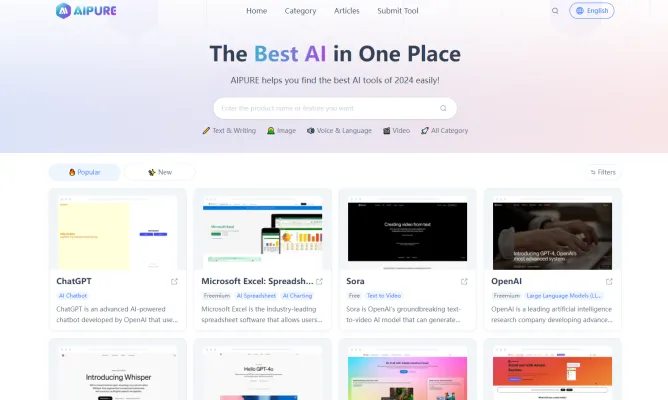

Nous Chatの公開は、安全で倫理的なAIインタラクションを追求する上で重要な進歩を表しています。私たちが人工知能の複雑さに対処し続ける中で、Nous Chatのようなツールは、エンゲージメントや機能性を損なうことなく、より安全なユーザー体験への道を切り開いています。AIイノベーションとツールについてさらに詳しく知りたい方は、人工知能に関する最新の開発について包括的な洞察とリソースを提供するAIPUREをご覧ください。