在 2024年12月11日,Google 推出了 Gemini 2.0,这是一款开创性的AI模型,旨在开启代理体验的新时代。该模型在其前身 Gemini Flash 2.0 的基础上,集成了先进的多模态功能,使其能够无缝理解和处理多种数据格式。Gemini 2.0 的推出不仅是为了提高性能;它标志着向创建能够更自主运行同时仍受用户监督的AI系统的重要转变。

Gemini 3 Pro 是 Google 最智能的 AI 模型,它可以无缝地合成文本、图像、视频、音频和代码中的信息,并具有最先进的推理能力和多模态理解能力,可帮助您将任何想法变为现实。

访问网站

👉在这里阅读官方文章:介绍 Gemini 2.0:我们的新时代AI模型(https://blog.google/technology/google-deepmind/google-gemini-ai-update-december-2024)

Gemini 2.0 的主要功能

Gemini 2.0 拥有多种显著增强其可用性和功能的特性:

- 多模态处理:该模型可以处理各种输入类型——文本、图像、音频和视频——从而实现更丰富的交互。例如,它可以生成基于文本的响应,并附带相关图像或音频输出。

- 深度研究功能:其突出功能之一是 Gemini Deep Research,它允许AI通过编译详细的报告来帮助用户探索复杂主题,这些报告基于广泛的推理和上下文理解。

- Project Astra:该计划致力于创建一个可以跨多种语言进行自然对话的AI助手,同时有效利用 Google Docs 和 Maps 等工具进行实际应用。

- Project Mariner:这是一个早期研究原型,通过浏览器集成探索未来的人机交互。它可以理解和推理浏览器中显示的信息,帮助高效完成任务。

- 增强的记忆和对话:凭借改进的记忆能力,Gemini 2.0 可以在更长的交互中保留上下文,使对话更加个性化和连贯。

对用户和开发者的意义

Gemini 2.0 的推出将影响多个领域:

- 增强用户体验:对于日常用户,能够以更自然和直观的方式与AI互动可以简化从安排约会到进行研究的各种任务。

- 开发者工具:开发者将受益于 Google Gemini API 提供的新功能,无需广泛的编码知识即可将复杂的AI功能集成到应用程序中。实验模型 Gemini Flash 2.0 也可以通过 Google AI Studio 中的 Gemini API 获得。

- 创意应用:该模型的多模态性质为创意领域(如图形设计和内容创作)开辟了新的途径,用户可以利用 AI Studio 等AI工具轻松生成多媒体输出。

Gemini 2.0 的未来

随着 Google 不断完善其AI技术,Gemini 2.0 的推出表明了其致力于开发能够以最少的人工干预执行复杂任务的更自主系统的承诺。尽管 Google CEO Sundar Pichai 承认未来的进步可能会越来越具有挑战性,但他强调这些突破对于AI技术的进化至关重要。

除了 Gemini 2.0,Google 还在推进像 Project Mariner 这样的项目,旨在进一步增强AI系统和用户之间的协作。将这些高级功能集成到日常应用中可能会重新定义我们在日常生活中与技术的互动方式。

随着来自开发者和用户的持续反馈,Google 致力于增强其AI模型的安全性和伦理考虑。引入像 Gemini Flash 2.0 以及 Google Jules(一种面向开发者的实验性代码代理)等工具,确保用户能够访问前沿技术,同时保持对其互动的控制。

Gemini 2.0 是 Google 对于一种能够理解并代表用户行动的通用助手的愿景的体现,同时确保用户仍然控制其互动。

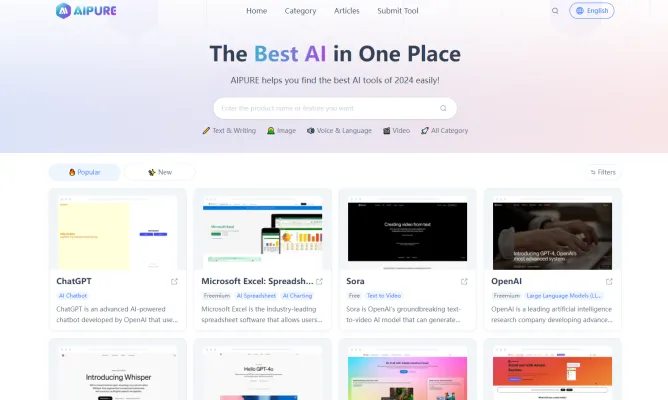

AIPURE是一个综合平台,通过易于使用的搜索界面帮助用户发现和探索2024年最佳AI工具和服务。

访问网站

访问 AIPURE 了解更多关于AI工具的最新发展,获取关于人工智能创新的全面见解和资源。